Warum über KI lernen

5 Warum nicht einfach KI einsetzen? — Teil 1

Die zweite extreme Position, wenn es um KI geht, ist der wahllose Einsatz oder Missbrauch der Technologie. Künstliche Intelligenz funktioniert anders als menschliche Intelligenz. KI-Systeme können aufgrund der Art der Situation, des Designs oder der Daten anders funktionieren als erwartet.

Eine Anwendung, die mit einem bestimmten Datensatz für einen bestimmten Zweck entwickelt wurde, funktioniert beispielsweise mit anderen Daten für einen anderen Zweck weniger gut. Es lohnt sich, die Grenzen der künstlichen Intelligenz zu kennen und zu korrigieren. Es ist gut, KI nicht einfach nur einzusetzen, sondern ihre Vorteile und Grenzen zu kennen.

Verfestigung von Stereotypen

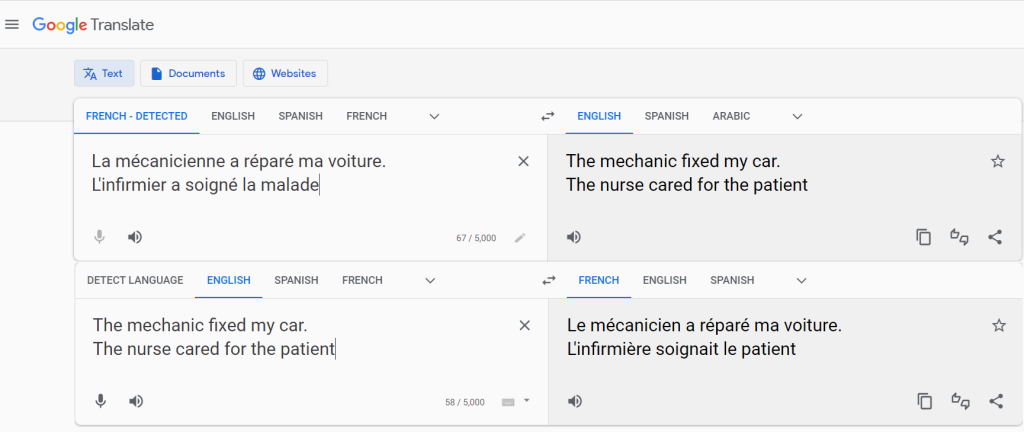

Google Translate lernt aus dem Internet, wie man am besten übersetzt. Seine „Datenschürfer” durchforsten das öffentliche Internet nach Daten, aus denen sie lernen können. Zusammen mit der Sprache lernt die KI, dass die Zahl der männlichen Mechaniker höher ist als die der weiblichen oder dass die Zahl der weiblichen Krankenschwestern die der männlichen in den Schatten stellt. Sie kann nicht unterscheiden, was „wahr” ist und was das Ergebnis von Stereotypen und anderen Vorurteilen ist. So verbreitet Google Translate am Ende, was es lernt, und verfestigt Stereotypen1:

Probleme treten bei der KI immer dann auf, wenn ein Einzelfall von der Mehrheit abweicht (unabhängig davon, ob diese die Mehrheit in der realen Welt existiert oder nur die Mehrheit wiedergibt, wie sie im Internet dargestellt wird). Im Klassenzimmer muss die Lehrkraft die Fehler des Systems ausgleichen. Und wenn nötig, die Aufmerksamkeit der Schülerinnen und Schüler auf Alternativtexte und -informationsquellen lenken.

ERKUNDEN SIE

Können Sie in Google Translate ein weiteres Beispiel für Stereotype finden? Spielen Sie mit dem Übersetzen in und aus verschiedenen Sprachen. Indem Sie auf die beiden Pfeile zwischen den Kästchen klicken, können Sie den übersetzten Text umkehren (so wie im obigen Beispiel gezeigt).

Sprachen wie Türkisch haben das gleiche Wort für „er” und „sie”. Bei der Übersetzung vom Türkischen ins Türkische und zurück kommen viele Stereotypen zum Vorschein. Beachten Sie, dass viele Sprachen eine männliche Voreingenommenheit haben — bei einer unbekannten Person wird angenommen, dass sie männlich ist. Dies ist nicht die Voreingenommenheit der Anwendung, sondern der Datenlage.

Mehrere Genauigkeitsmessungen

KI-Systeme machen Vorhersagen — Vorhersagen darüber, was ein Schulkind als Nächstes lernen sollte, ob es ein Thema verstanden hat, welche Gruppenaufteilung für eine Klasse gut ist oder wann ein Schulkind Gefahr läuft, die Schule abzubrechen. Oft sind diese Vorhersagen mit einer Prozentzahl versehen. Diese Zahl sagt uns, wie gut das System seine Vorhersagen einschätzt.

KI-Systeme machen Vorhersagen — Vorhersagen darüber, was ein Schulkind als Nächstes lernen sollte, ob es ein Thema verstanden hat, welche Gruppenaufteilung für eine Klasse gut ist oder wann ein Schulkind Gefahr läuft, die Schule abzubrechen. Oft sind diese Vorhersagen mit einer Prozentzahl versehen. Diese Zahl sagt uns, wie gut das System seine Vorhersagen einschätzt.

Es liegt in der Natur der Sache, dass Vorhersagen fehlerhaft sein können. Bei vielen Anwendungen ist ein solcher Fehler akzeptabel. In einigen Fällen ist er nicht akzeptabel. Außerdem ist die Art und Weise, wie dieser Fehler berechnet wird, nicht festgelegt. Es gibt verschiedene Maßstäbe, und die programmierende Person wählt aus, welchen sie für den wichtigsten hält. Oft ändert sich die Genauigkeit je nach Eingabe.

Da diese Systeme in einem Klassenzimmer Vorhersagen über Kinder und Jugendliche treffen, muss die Lehrkraft beurteilen, was akzeptabel ist, und handeln, wenn eine von der KI getroffene Entscheidung nicht angemessen ist. Dazu ist ein wenig Hintergrundwissen über KI-Techniken und die mit ihnen verbundenen häufigen Fehler sehr hilfreich.

1 Barocas, S., Hardt, M., Narayanan, A., Fairness and machine learning Limitations and Opportunities, 2022.