Pourquoi devons-vous apprendre à connaître l’IA ?

5 Pourquoi ne pas simplement se mettre à l’IA – Partie 1

La deuxième position extrême en matière d’IA est l’utilisation inconsidérée ou l’abus de cette technologie. L’intelligence artificielle fonctionne différemment de l’intelligence humaine. Que ce soit en raison de la nature de la tâche, de sa configuration ou des données, les systèmes d’IA peuvent fonctionner différemment de ce que l’on attend d’eux.

Par exemple, une application développée à partir d’un ensemble de données dans un but précis ne fonctionnera pas aussi bien sur d’autres données dans un autre but. Il est payant de connaître les limites de l’intelligence artificielle et d’y pallier : il est judicieux de ne pas se contenter de l’IA mais d’en connaître les avantages et les limites.

Perpétuation des stéréotypes

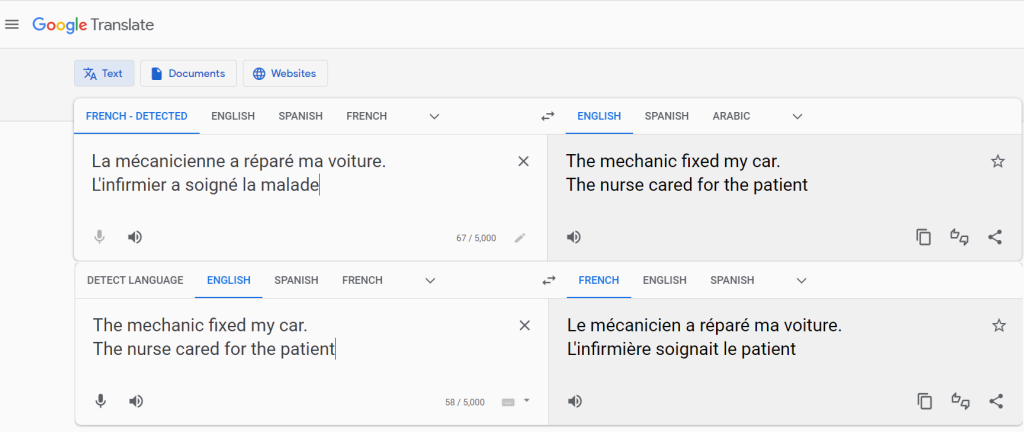

Google translate apprend à traduire à partir d’Internet. Ses » explorateurs de données » parcourent le Web public à la recherche de données à partir desquelles ils peuvent apprendre. Outre le langage, l’IA apprend que le nombre de mécaniciens masculins est supérieur à celui des mécaniciennes. Que le nombre d’infirmières éclipse celui des infirmiers. Elle ne peut pas faire la différence entre ce qui est « vrai » et ce qui est le résultat de stéréotypes et autres préjugés. Ainsi, Google Translate finit par propager ce qu’il apprend, renforçant encore plus les stéréotypes1:

Des problèmes apparaissent avec l’IA dès qu’un cas individuel diffère du cas majoritaire (que celui-ci représente fidèlement la majorité dans le monde réel ou simplement la majorité telle qu’elle est représentée par Internet). Dans les écoles, l’enseignant doit compenser les défaillances du système. Et, si nécessaire, diriger l’attention des élèves vers le texte alternatif.

Explorez

Pouvez-vous chasser un stéréotype dans Google Translate? Jouez avec la traduction de et vers différentes langues. En cliquant sur les deux flèches entre les cases, vous pouvez inverser ce qui est traduit (C’est ce que nous avons fait pour l’exemple ci-dessus).

Des langues comme le turc ont le même mot pour « il » et « elle ». De nombreux stéréotypes apparaissent lorsque vous traduisez du turc et inversement. Notez que de nombreuses langues ont un biais masculin – une personne inconnue est supposée être un homme. Ce n’est pas le biais de l’application. Ce qui est choquant dans notre exemple ci-dessus, c’est que l’infirmier est transformé en femme.

Plusieurs mesures de précision

Les systèmes d’IA font des prédictions – des prédictions sur ce que les élèves devraient étudier ensuite, s’ils ont compris un sujet, quelle répartition du groupe est bonne pour une promotion ou quand un élève risque d’abandonner ses études. Souvent, ces prédictions sont accompagnées d’un pourcentage. Ce chiffre nous indique à quel point le système estime que ses prédictions sont fiables.

Les systèmes d’IA font des prédictions – des prédictions sur ce que les élèves devraient étudier ensuite, s’ils ont compris un sujet, quelle répartition du groupe est bonne pour une promotion ou quand un élève risque d’abandonner ses études. Souvent, ces prédictions sont accompagnées d’un pourcentage. Ce chiffre nous indique à quel point le système estime que ses prédictions sont fiables.

De par sa nature même, la prédiction peut être erronée. Dans de nombreuses applications, il est acceptable d’avoir cette erreur. Dans certains cas, elle ne l’est pas. De plus, la façon dont cette erreur est calculée n’est pas fixe. Il existe différentes mesures et le programmeur choisit celle qui lui semble la plus pertinente. Souvent, la précision change en fonction de l’entrée elle-même.

Puisque, dans une salle de classe, ces systèmes font des prédictions sur les enfants, c’est à l’enseignant de juger ce qui est acceptable et d’agir lorsqu’une décision prise par l’IA n’est pas appropriée. Pour ce faire, un petit historique des techniques d’IA et des erreurs courantes qui leur sont associées sera très utile.

1 Barocas, S., Hardt, M., Narayanan, A., Fairness and machine learning Limitations and Opportunities, 2022.